DeepL 2026 : avis complet et nouveautés pour les professionnels

Avis DeepL 2026 : nouveaux modèles, 81 langues, glossaires v3, SRT, changements d'API. Ce que ça change concrètement pour traducteurs, agences et équipes produit — avec comparatif face à ChatGPT et Google Translate.

Mis à jour le 14 avril 2026

Verdict rapide

- DeepL est toujours le meilleur outil de traduction automatique pour les textes spécialisés (juridique, technique, médical)

- Les modèles next-gen réduisent significativement les besoins de post-édition sur les langues majeures

- Les nouvelles fonctionnalités (glossaires v3, contexte, règles de style, SRT) sont de vrais leviers opérationnels — pas du marketing

- Point d'attention : l'authentification legacy (query param) est obsolète depuis nov. 2025 — à corriger en urgence si vous avez des intégrations

- Pour les textes créatifs ou marketing : ChatGPT/Claude reste plus souple ; DeepL reste plus précis

DeepL vs concurrents en 2026 : le comparatif qui compte

| Critère | DeepL Pro | ChatGPT-4o | Google Translate | Systran |

|---|---|---|---|---|

| Qualité textes spécialisés | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| Textes créatifs / marketing | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ |

| Nombre de langues | 31 (+ 81 bêta promues) | 50+ | 133 | 50+ |

| Glossaires personnalisés | ✅ Natif v3 | ⚠️ Via prompt | ❌ | ✅ |

| API robuste | ✅ | ✅ | ✅ | ✅ |

| Confidentialité / on-premise | ✅ Enterprise | ⚠️ Limité | ❌ | ✅ |

| Traduction de fichiers | ✅ PDF, DOCX, SRT, XLIFF | ⚠️ Via plugin | ✅ Limité | ✅ |

| Prix entrée | 10 €/mois | 20 €/mois | Gratuit / API usage | Sur devis |

| Idéal pour | Pros, agences, docs | Créatif, multiusage | Volume, interne | Enterprise régulé |

Tarifs DeepL 2026 : ce que ça coûte vraiment

| Plan | Prix | Caractères/mois | Utilisateurs | Glossaires |

|---|---|---|---|---|

| DeepL Free | Gratuit | 500 000 | 1 | Non |

| DeepL Starter | 10 €/mois | 1 000 000 | 1 | 1 glossaire |

| DeepL Advanced | 30 €/mois | Illimité | 1 | Illimité |

| DeepL Ultimate | 60 €/mois | Illimité | 3 | Illimité + API |

| DeepL API Free | Gratuit | 500 000 | – | Non |

| DeepL API Pro | À partir de 7,50 €/mois | Facturation usage | – | ✅ |

| Enterprise | Sur devis | Illimité | Illimité | Tout + SSO |

Prix indicatifs HT — vérifier sur deepl.com pour les tarifs en vigueur.

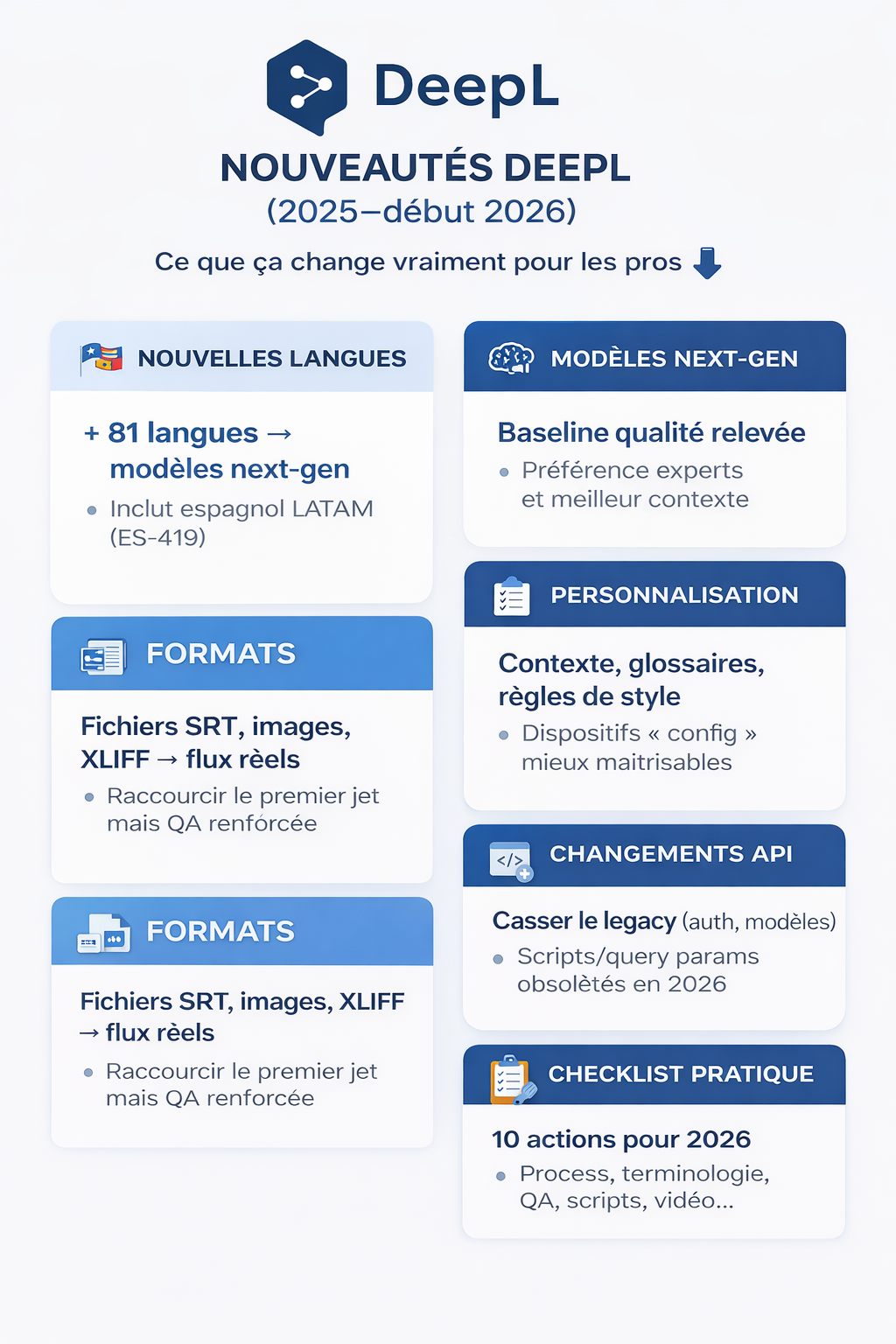

DeepL évolue vite, et les "petites" nouveautés techniques finissent souvent par avoir un gros impact côté production (qualité, cohérence, coûts, vitesse). Entre l'arrivée de dizaines de langues, la généralisation des modèles next-gen, des options de personnalisation plus poussées (contexte, règles de style, instructions), et des changements d'API qui cassent les anciens scripts, 2026 commence avec un message clair : si vous utilisez DeepL en pro, votre workflow doit être mis à jour.

Dans cet article, je passe en revue les nouveautés les plus utiles et ce qu'elles impliquent concrètement pour les traducteurs, agences, équipes localisation, marketing, juridique et produit.

1) Le vrai tournant : plus de langues, mais pas "comme avant"

81 langues "bêta" deviennent standard… avec une contrainte importante

Côté DeepL API, DeepL a promu toutes les 81 langues bêta au rang de "standard language support" en Q1 2026. Mais il y a un détail qui change tout : ces langues fonctionnent avec le modèle quality_optimized (ou si aucun modèle n'est spécifié) et ne sont pas compatibles avec les requêtes latency_optimized. Autrement dit : si vous aviez optimisé vos appels API pour la vitesse, vous devrez arbitrer.

Avant, les langues bêta avaient des limites

Quand DeepL a introduit 75 nouvelles langues (initialement via enable_beta_languages), elles n'étaient pas facturées pendant la bêta et ne supportaient pas encore glossaires ni formalité. Ces contraintes expliquent pourquoi certains tests "bêta" pouvaient paraître très bons sur du texte simple, puis décevoir dès qu'on avait besoin de cohérence terminologique.

Focus utile : espagnol Amérique latine (ES-419)

DeepL a ajouté ES-419 (espagnol latino-américain) mais, là encore, uniquement via les modèles next-gen dans l'API au lancement. C'est un point important si vous localisez pour LATAM : vos paramètres de modèle deviennent un élément de QA.

2) Next-gen models : pas juste un slogan marketing, un levier opérationnel

DeepL met clairement en avant ses modèles next-gen (LLM) comme standard de qualité. Dans sa communication, DeepL indique que ses modèles next-gen sont préférés par des experts linguistiques plus souvent que certains concurrents dans des tests en aveugle, et que ces modèles réduisent les besoins de post-édition.

Ce que ça change pour un pro

-

Votre "baseline" qualité évolue : des segments courts, ambigus, ou très contextuels (UI, microcopy, titres) sortent souvent mieux… à condition d'alimenter le système avec les bons signaux (voir la section contexte).

-

Votre QA doit être plus ciblée : moins de corrections "grammaire/fluide", plus de contrôles "intention, terminologie, registre, cohérence cross-fichiers".

3) La personnalisation devient (enfin) exploitable : contexte, glossaires, règles de style, instructions

A) Le paramètre context : l'anti-boulette sur les textes courts

DeepL documente désormais très explicitement l'objectif : le paramètre context sert à désambiguïser et à mieux traduire des snippets courts (titres, noms produit, phrases isolées), en fournissant "l'avant/après" comme le ferait un traducteur humain.

Point crucial : DeepL insiste sur ce que context n'est pas. Ce n'est pas un prompt type ChatGPT ("traduis sur un ton amical"), ni une liste de règles ("toujours traduire X par Y"). Pour ça, DeepL renvoie plutôt vers règles de style / instructions et glossaires.

Implication directe : si vous utilisez DeepL en pro sur de la microcopy (boutons, menus, slogans, titres), vous avez maintenant un vrai bouton "anti-ambiguïté" à intégrer dans vos pipelines.

B) Glossaires : passage à la vitesse supérieure (édition + multilingue)

Côté API, DeepL a amélioré les glossaires avec :

- la possibilité d'éditer des glossaires,

- la création de glossaires multilingues (et plus seulement mono-cible).

La doc v3 insiste d'ailleurs sur le fait que les endpoints v3 sont ceux à privilégier pour tous les besoins glossaires (mono et multi).

Et côté produit, DeepL pousse aussi un "glossary generator" (génération de glossaire depuis des traductions existantes), utile pour industrialiser une base terminologique à partir d'historiques.

Exemple concret — créer un glossaire v3 via API :

POST https://api.deepl.com/v3/glossaries

Authorization: DeepL-Auth-Key YOUR_API_KEY

Content-Type: application/json

{

"name": "Glossaire juridique FR-EN",

"source_lang": "fr",

"target_lang": "en",

"entries": [

{ "source": "prestataire", "target": "service provider" },

{ "source": "donneur d'ordre", "target": "principal" },

{ "source": "clause pénale", "target": "liquidated damages clause" }

]

}

La réponse renvoie un glossary_id que vous passez ensuite dans vos appels de traduction :

{

"text": ["Le prestataire est responsable."],

"target_lang": "EN",

"glossary_id": "VOTRE_GLOSSARY_ID"

}

Pour les glossaires multilingues v3, vous pouvez créer un glossaire avec plusieurs paires cibles dans le même objet, et le référencer par un ID unique dans tous vos appels — ce qui simplifie considérablement la gestion pour les agences qui travaillent sur 5+ langues cibles avec les mêmes terminologies.

C) Règles de style et "custom instructions" : la couche "brief"

Dans les release notes API, DeepL mentionne :

- l'ajout de support des

style rulesdans l'API, pour récupérer des règles créées et traduire avec, - l'ajout d'un paramètre permettant des

custom instructions(exemple donné : "Use a friendly, diplomatic tone").

Ce que ça change : on passe d'un usage "outil de traduction" à un usage "moteur configurable", où le brief devient en partie exécutable.

4) Traduction de fichiers : SRT, images, XLIFF… DeepL vise les flux réels

A) SRT (sous-titres) : un cas d'usage qui explose

DeepL met en avant la traduction de fichiers SRT via web translator, applis desktop et API, et confirme le format supporté. Et côté API "document translation", SRT apparaît dans la liste des formats supportés.

Pour les pros (audiovisuel, e-learning, creators, SaaS vidéo), c'est un gain énorme : vous pouvez faire un premier jet très rapide, puis concentrer l'effort humain sur :

- la lisibilité (longueur ligne, segmentation),

- les contraintes de timing,

- la cohérence terminologique et ton.

B) Images en traduction de documents (beta)

DeepL a aussi ajouté le support JPEG/PNG en traduction de documents (en bêta). Voici ce que ça signifie concrètement, au-delà du simple "ça marche" :

Ce que la fonctionnalité fait :

- DeepL extrait le texte de l'image (OCR intégré), traduit le contenu, et retourne une image avec le texte remplacé.

- Fonctionne sur les captures d'écran, photos de documents, slides exportées en image, visuels de manuels.

Cas d'usage réels :

- Support client international : traduire des captures d'écran d'interfaces ou d'erreurs envoyées par des clients étrangers.

- Ops et documentation interne : intégrer des captures d'outils en langue étrangère dans des wikis ou SOP en français.

- E-learning : pré-traduction de slides visuelles avant retraitement graphique.

Limites à connaître en bêta :

- La qualité OCR dépend fortement de la résolution et du contraste de l'image. Les polices stylisées, les textes sur fond complexe ou les petits caractères donnent des résultats variables.

- Le rendu visuel (position du texte, taille de police, mise en page) peut ne pas correspondre à l'original — DeepL place le texte traduit mais ne recrée pas la maquette graphique.

- Non adapté aux supports de communication finale (publicités, packaging, UI officielle) sans retouche graphique manuelle ensuite.

- La bêta ne garantit pas une disponibilité ou des SLA de production : à tester sur un flux secondaire avant de l'intégrer dans un process critique.

C) XLIFF 2.1 : important pour la localisation produit

La doc DeepL rappelle le support des fichiers XLIFF en version 2.1 dans la traduction de documents. Pour les équipes localisation, c'est un point structurant : on n'est plus uniquement sur du "copier-coller", on est sur des artefacts de prod.

5) Développeurs et équipes produit : les changements d'API à ne pas rater

Fin des authentifications "legacy" (query param / body)

DeepL a progressivement déprécié puis rendu obsolète l'authentification via auth_key en query param ou dans le body. Fini le générateur de clé API DeepL en query string — tout passe désormais par le header :

- annonce de dépréciation (mars 2025) :

/translateen POST seulement, plus de GET ni query params, et authentification via headerAuthorization, - obsolescence complète (novembre 2025) : plus possible d'authentifier via query param ou body.

La doc "Access and authentication" rappelle d'ailleurs la nécessité de garder la clé confidentielle et de ne pas l'exposer côté client.

Conséquence business : si vous aviez des scripts "rapides" bricolés en URL, ou des intégrations no-code qui passaient par query param, c'est typiquement le genre de détail qui fait tomber une chaîne de prod un lundi matin. En 2026, le minimum est un audit des intégrations.

Migration en pratique — avant/après :

❌ Ancienne méthode (obsolète depuis nov. 2025) :

POST https://api-free.deepl.com/v2/translate

Content-Type: application/x-www-form-urlencoded

auth_key=YOUR_API_KEY&text=Bonjour&target_lang=EN

✅ Nouvelle méthode (header Authorization) :

POST https://api-free.deepl.com/v2/translate

Authorization: DeepL-Auth-Key YOUR_API_KEY

Content-Type: application/json

{

"text": ["Bonjour"],

"target_lang": "EN"

}

Points clés de la migration :

- La clé passe du body/query param au header HTTP

Authorization. - Le format du body passe de form-encoded à JSON (recommandé).

- Pour l'API Pro, remplacez

api-free.deepl.comparapi.deepl.com. - Si vous utilisez un SDK officiel DeepL (Python, Node.js, etc.), une mise à jour de version suffit généralement — les SDK récents gèrent déjà la nouvelle auth.

6) Ce que ça change concrètement selon votre profil

Traducteur freelance

-

Vous devez déplacer votre valeur : moins de temps sur le "premier jet", plus sur l'édition stratégique (intention, style, cohérence, terminologie client).

-

Votre différenciation se joue sur le contrôle : glossaires, règles de style, instructions, QA, et capacité à intégrer DeepL dans un process propre.

-

Opportunité : proposer des offres "setup" (glossaire + règles + guide style + protocole QA) plutôt que de vendre uniquement du mot.

Agence de traduction / localisation

-

DeepL devient plus intéressant quand vous industrialisez : glossaires multilingues v3, key management, analytics, contrôle des coûts et limites par clé (et, plus généralement, gouvernance).

-

Les nouvelles langues et ES-419 imposent une stratégie de modèle et des tests par couple linguistique.

Équipes marketing et communication

-

DeepL Write existe côté API, avec une liste de langues supportées (DE, EN-GB, EN-US, ES, FR, IT, PT-BR, PT-PT).

-

Avec les "custom instructions" et règles de style, vous pouvez viser une homogénéité de ton plus stable, mais il faut un cadre (brief, validations, échantillonnage QA).

Juridique, finance, secteurs régulés

- Dans le comparatif traduction juridique DeepL vs IA, DeepL garde l'avantage sur la précision terminologique. Les gains de vitesse existent, mais la priorité reste la maîtrise : terminologie, cohérence, traçabilité, et règles de diffusion des contenus. Les changements d'auth et les options enterprise (agent, hub de personnalisation) montrent que DeepL cible explicitement ces usages, mais l'implémentation doit être encadrée.

7) Confidentialité des données et RGPD : ce que DeepL garantit (et ce qu'il ne garantit pas)

C'est un angle souvent négligé dans les comparatifs, mais crucial pour les secteurs juridiques, médicaux et RH.

Ce que DeepL propose par plan

| Plan | Stockage des textes | Utilisation pour entraînement | Hébergement |

|---|---|---|---|

| Free / Starter | Suppression automatique (délai variable) | Possible selon CGU | Serveurs UE |

| Advanced / Ultimate | Option "no storage" activable | Non (si no storage) | Serveurs UE |

| API Pro | Non stocké par défaut | Non | Serveurs UE |

| Enterprise | Non stocké + audit trail | Non | UE + options on-premise |

Point clé : DeepL affirme héberger ses données exclusivement en Europe (Allemagne principalement) — un avantage concurrentiel réel face à OpenAI (serveurs US) pour les entreprises soumises au RGPD.

Ce que le RGPD implique pour vous

Si vous traitez des données personnelles via DeepL (noms de clients, courriers, dossiers RH, données médicales), vous êtes responsable de traitement et DeepL est sous-traitant. Cela signifie :

- Vous devez disposer d'un Data Processing Agreement (DPA) signé avec DeepL. DeepL propose un DPA standard pour les plans payants — vérifiez qu'il est en vigueur.

- Vous devez mentionner DeepL dans votre registre des traitements si vous traitez des données personnelles via l'outil.

- Pour les données de santé ou données judiciaires (catégories "sensibles" au sens RGPD), l'utilisation d'un outil cloud — même avec no-storage — doit être analysée juridiquement avant déploiement.

Comparaison confidentialité vs concurrents

| Outil | Hébergement | DPA disponible | No-storage par défaut |

|---|---|---|---|

| DeepL Pro/API | UE (Allemagne) | ✅ | ✅ API, option autres plans |

| ChatGPT / OpenAI API | US (Azure possible) | ✅ (API) | ✅ si API, non si interface web |

| Google Translate API | Global / US | ✅ | ✅ API |

| Systran on-premise | Vos serveurs | N/A | ✅ par design |

Conclusion : pour les secteurs régulés, DeepL API Pro est généralement le choix le plus simple à justifier auprès d'un DPO. Pour les cas les plus sensibles, Systran on-premise reste la seule option garantissant que les données ne quittent jamais votre infrastructure.

8) Checklist "DeepL prêt pour 2026" (actionnable)

-

Lister toutes vos intégrations DeepL (applis, plug-ins, scripts, no-code, API).

-

Vérifier l'authentification : header

Authorizationuniquement. -

Sur les langues récentes/promues : valider le modèle (

quality_optimizedvslatency_optimized). -

Mettre en place une règle : snippets courts =

contextsystématique. -

Centraliser la terminologie : migrer/standardiser sur glossaires v3 (et multi si besoin).

-

Définir ce qui relève de

contextvs glossaire vs règles de style. -

Si vous faites de la vidéo : tester le flux SRT (API ou traducteur web) + définir une grille QA dédiée.

-

Si vous traitez des visuels : considérer l'image (beta) mais cadrer les limites.

-

Créer un protocole d'échantillonnage QA par couple de langues, surtout sur les nouveaux couples (ES-419, langues promues).

-

Documenter votre process : la différence entre "utiliser DeepL" et "produire avec DeepL", c'est la reproductibilité.

-

Vérifier que votre DPA avec DeepL est en vigueur (plans Pro et API).

-

Si vous traitez des données personnelles : mentionner DeepL dans votre registre des traitements RGPD.

Conclusion : DeepL devient un moteur, pas un simple traducteur

La tendance est nette : DeepL ne se contente plus d'améliorer la qualité de traduction. Il construit une plateforme "Language AI" de plus en plus configurable (contexte, glossaires v3, règles de style, instructions), qui vise les workflows réels (documents, SRT, XLIFF, images) et les intégrations structurées (API, gouvernance, analytics).

Pour les pros, la question en 2026 n'est plus "Est-ce que DeepL est bon ?", mais plutôt : est-ce que mon process est conçu pour exploiter DeepL sans perdre le contrôle ?

→ Pour aller plus loin : IA et traduction en 2026 : état des lieux, meilleurs outils et avenir du métier

FAQ — Questions fréquentes sur DeepL en 2026

DeepL est-il gratuit en 2026 ? DeepL propose un plan gratuit limité à 500 000 caractères/mois sans glossaire. Pour un usage professionnel, les plans payants commencent à 10 €/mois (Starter). L'API a également un tier gratuit (500 000 caractères) avant facturation à l'usage.

DeepL est-il meilleur que Google Translate ? Pour les textes professionnels et spécialisés : oui, DeepL est généralement supérieur en qualité, notamment sur les nuances stylistiques et la terminologie. Google Translate couvre plus de langues (133 vs 31+) et reste pertinent pour le volume ou les langues rares non couvertes par DeepL.

DeepL est-il meilleur que ChatGPT pour traduire ? Ça dépend du contenu. DeepL excelle sur les textes techniques, juridiques et structurés. ChatGPT est plus souple pour les textes créatifs, marketing, ou quand vous avez besoin d'instructions stylistiques complexes. Beaucoup de pros utilisent les deux selon le type de document.

Peut-on utiliser DeepL de façon confidentielle ? Oui — DeepL Pro propose une option "no data storage" (les textes ne sont pas utilisés pour entraîner les modèles). Les plans Enterprise offrent des options de déploiement avec contrôle accru des données. Pour les secteurs très régulés, Systran propose des solutions on-premise.

DeepL supporte-t-il les fichiers SRT et XLIFF ? Oui depuis 2025-2026. DeepL supporte la traduction de fichiers SRT (sous-titres), XLIFF 2.1, PDF, DOCX, PPTX et JPEG/PNG (bêta). C'est un changement significatif pour les équipes localisation et audiovisuel.

Quels sont les changements d'API DeepL à connaître en 2026 ?

L'authentification via query param ou body (auth_key) est obsolète depuis novembre 2025. Vous devez utiliser le header Authorization: DeepL-Auth-Key [clé]. Tous les scripts et intégrations no-code doivent être mis à jour sous peine de pannes silencieuses.

Vous aimerez aussi

Comparatif CAT tools 2026 : Trados, memoQ, Phrase, Wordfast et OmegaT

Quel outil de traduction assistée (CAT tool) choisir en 2026 ? Comparatif terrain de SDL Trados, memoQ, Phrase, Wordfast et OmegaT : tarifs, courbe d'apprentissage, intégration IA, formats supportés et recommandations par profil.

Lire l'article →DeepL API en 2026 : obtenir une clé API, tarifs et intégration pour traducteurs

Comment obtenir une clé API DeepL, comprendre les plans gratuit et Pro, et intégrer DeepL dans vos outils de traduction (Trados, memoQ, scripts). Guide complet pour traducteurs et développeurs.

Lire l'article →DeepL vs IA généraliste pour la traduction juridique en 2026 : comparatif terrain

DeepL ou ChatGPT pour traduire des contrats, actes et jugements ? Comparatif détaillé sur des textes juridiques réels : précision terminologique, risques d'erreur et recommandations selon le type de document.

Lire l'article →